Dropbox 會偷資料給 OpenAI 訓練資料嗎? 比較各家 AI 服務的資料隱私條款

今天看到大家在傳一則 2023/12 的科技新聞How to stop Dropbox from sharing your personal files with OpenAI 大意是說

- 如果您使用過 Dropbox 的任何 AI 工具,您的某些文件和檔案可能已暫時與 OpenAI 伺服器共用,除非您選擇退出。

- 即使您選擇退出,與使用 Dropbox AI 的其他人共享的任何檔案仍然可以傳送到 OpenAI 伺服器。

- Dropbox 執行長 Drew Houston 解釋說,只有當人們主動與Dropbox AI 功能互動時,數據才會傳輸,而這些功能本身就被明確標記,並且「此設定或任何其他設定都不會自動或被動地將任何Dropbox 客戶資料傳送到第三方服務。」

還有教學,說如何進到 Dropbox 帳戶中把那個共享資料功能的關掉。

If you're using @Dropbox, they've enabled sharing your personal documents with OpenAI by default. To turn it off, log into your Dropbox account on the web, go to Settings, then turn it off in the Third Party AI tab pic.twitter.com/bl6fnGTQfJ

— Igal Tabachnik (@hmemcpy) December 13, 2023

聽起來很危言聳聽對吧?

大家可能在 Dropbox 上面放了一些機密資料,怎麼可以給別人看?

萬一別人在使用 AI 生成時,跑出我的資料,這不是很糟糕嗎?

不過我在 Dropbox 的設定中。卻遍尋不著教學中那個 Third-Party AI 的開關。

仔細想了一下,Dropbox 何時有 AI 功能?

仔細看了一下官網資料…

關於 Dropbox 使用 AI 的隱私權常見問題集

本文介紹的 Alpha 版功能開放以下客戶使用:

- 訂購 Dropbox Professional、Essentials、Business、Business Plus 的客戶及部分 Dropbox Standard 和 Advanced 用戶。

- 偏好語言設為英文的國家/地區。不包含加拿大、英國和 EEA (歐洲經濟區) 內的國家/地區。

ㄜ..這是一個全民公測中的功能,

使用 Dropbox 台灣繁體中文版介面,沒得用。

使用 Dropbox 免費版(Basic Plan),沒得用。

就算免費版的沒得用 AI ,會不會拿存在上面的資料去訓練?

反正 Dropbox 說沒有,那就沒有好了,

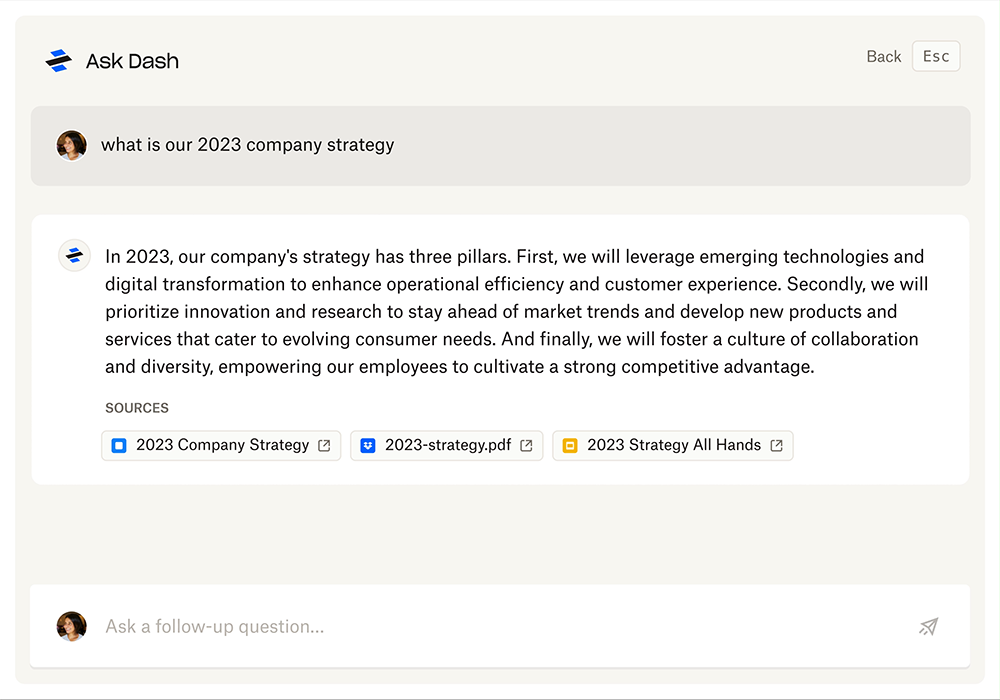

Dropbox 的 AI 功能Introducing Dropbox Dash, AI-powered universal search, and Dropbox AI是 2023/6 發佈的, 內容有更智慧的檔案搜尋、用 AI 幫長文章總結、選擇幾個檔案然後問 AI 關於檔案內容的問題…等等。

那市面上有類似功能的產品,

讓使用者把資料存在平台上,

平台有提供這種可能基於某人的檔案,來產生新內容的「好用」 AI 功能,

不是還很多間嗎?

於是決定去找來看看…

結果相當驚人,對於是否會拿使用者的資料來做 AI 訓練用途? 產生新資料給其他人用? 不少生成式 AI 服務廠商避而不談, 或是用一些曲折的敘述方式, 有些則是預設都會被利用,想要 Opt-out 還要自己另外設定。 這不乏一些台灣也很多人在用的服務。

也有的直球對決,表明不用使用者資料來訓練、不會共享 prompt、不會販賣資料,堪稱清流。

NotionAI

點擊查看條文摘要:

When you interact with the writing assistant or set up an autofill property, several steps occur in the background:

Notion receives a prompt from a user.

Data relevant to the prompt is sent to a AI LLM Subprocessors, which produces an output to send back to Notion.

Notion then processes the LLM’s output so that it adheres to the right format and language and displays the output to the user.

How is your data protected?

When sending data to our AI LLM Subprocessors, the data is encrypted in transit using TLS 1.2 or greater, and no Customer Data is used to train the model.

All our AI LLM Subprocessors only retain data for 30 days or less before deletion.

Only data the user has access to on the specific page where the AI Writer or Autofill is used will be sent to AI LLM Subprocessors to generate the output, meaning that the generated outputs provided to the user will not incorporate any data that the user did not already have access to.

在將數據傳送給我們的 AI LLM 處理器時,在傳輸過程中使用TLS 1.2或更高版本進行加密,且不使用任何客戶數據來訓練模型。

所有我們的AI LLM處理器只在刪除之前保留30天或更短時間的數據。

僅將用戶在使用AI Writer或Autofill所在特定頁面上可以訪問到的數據發送至AI LLM處理器以生成輸出,這意味著提供給用戶的生成輸出,不會包含任何用戶先前無法訪問到的數據。

Google Workspace Labs 隱私權聲明與個人帳號條款

How we’re protecting your Google Workspace data in the era of generative AI

例如 Google 文件,Google Meet 都加入了 AI 功能,有些是付費的 Google Workspace 才能用,但有些功能在公開測試期,個人帳號也可以用 VPN 改成美國去申請。

點擊查看條文摘要:

我們收集哪些數據? 選擇加入 Google Workspace 實驗室後,您將可以搶先使用 Gmail 和 Docs 等 Workspace 產品中整合的生成式 AI 功能。當您選擇加入 Workspace Labs 時,Google LLC (Google) 會收集您的 Workspace Labs 數據,包括以下內容:您的提示

使用者提供的輸入,例如突出顯示的文字或作為提示的一部分提供的明確引用的工作區內容 Google 選擇的輸入,其中包括 Workspace 內容,例如您的文件和電子郵件,Google 可能會自動處理這些內容以產生文件摘要或為您提供個人化的生成內容,例如

- 產生的輸出

- 對提示、輸入或產生的輸出的改進

- 回饋

谷歌還收集有關這些功能的使用情況的指標。

這些數據是如何使用的?

Google 使用 Workspace Labs 資料和指標來提供、改進和開發整個 Google 的產品、服務和機器學習技術,包括 Google 的企業產品。您可以隨時選擇退出 Google Workspace 實驗室。

您的工作區實驗室資料也可能出於上述目的由人工審核員讀取、評級、註釋和審核。因此,請勿在提示中包含可用於識別您或其他人身分的敏感、機密或個人資訊。在此過程中,我們會採取措施保護您的隱私。重要的是,當Google 使用Google 選擇的輸入(如上所述)產生輸出時,Google 將聚合和/或假名化該內容和結果輸出,然後再由人工審閱者進行評級或用於產品改進以及服務和機器學習技術的開發,除非它是您向 Google 提供的回饋中專門提供的。

Workspace Labs 資料的儲存方式與您的 Google 帳戶無關,並將保留 18 個月。經人工審核員審核或註記的 Workspace Labs 資料副本最多可保留 4 年。

請勿在提示中包含可用於識別您或其他人身分的敏感、機密或個人資訊。

在此過程中,Google 將聚合和/或假名化該內容和結果輸出,然後再由人工審閱者進行評級或用於產品改進以及服務和機器學習技術的開發,除非它是您向 Google 提供的回饋中專門提供的。

Gamma.app

Data and privacy in Gamma FAQ’s

點擊查看條文摘要:

What data does Gamma store and who can view that data? Can Gamma employees view my decks? Gamma stores your full deck securely in the cloud. While we're still in beta, we review aggregate usage information like the total number of decks created or the types of templates being copied to learn how people are using our product. However, Gamma employees won't view your decks unless you give your explicit permission.For more information, including how to contact us with privacy or data concerns, please see our full privacy policy.

Gamma 的平台功能這麼強,輸入一個題目就可以產生一堆圖文並茂的文件或簡報, 但關於資料隱私部份的說明卻是非常省話…

Microsoft Copilot

Copilot 隱私權與保護

適用於 Microsoft 365 的 Microsoft Copilot 的數據、隱私權和安全性

例如從 Microsoft Edge 側邊欄叫出 AI 來讀文件或總結,或是產生新內容,那些文件資料會被微軟偷幹走嗎? 還有 Microsoft 365 Copilot 的新方案,直接整合在各個辦公軟體內,根據貴組織資料產生回應,例如使用者文件、電子郵件、行事曆、聊天、會議和連絡人。那會不會在使用的同時將資料貢獻給微軟,作為 AI 訓練用?

點擊查看條文摘要:

這是商業資料保護在 中的 Copilot 運作方式:

- Copilot使用Microsoft Entra識別碼 (先前稱為 Azure Active Directory) 進行驗證,且只允許使用者使用其工作帳戶透過商業資料保護進行存取 Copilot 。

- 在聊天會話開始時,會從聊天資料中移除 Entra ID 使用者的租使用者和使用者資訊。 這項資訊僅用來判斷使用者是否符合商業資料保護的資格。 來自 Entra ID 使用者的提示所觸發的搜尋查詢不會由 Bing 連結到使用者或組織。

- 使用 Copilot 時,Microsoft 不會保留 Entra ID 使用者的提示或回應。為了執行時間目的,提示和回應會維持一段簡短的快取期間。關閉瀏覽器、重設聊天主題或會話逾時之後,Microsoft 會捨棄提示和回應。

- 透過商業資料保護來回傳送的 Copilot 聊天資料會在傳輸中加密, (TLS 1.2+) ,並在聊天會話期間 (AES-128) 待用。 Microsoft 沒有其「眼球」存取權。

- 由於 Microsoft 不會保留提示和回應,因此無法作為基礎大型語言模型定型集的一部分。

- 顯示給 Entra ID 使用者的廣告並非以工作場所身分識別或聊天記錄為目標。

這些資料保護可延伸到copilot.microsoft.com和Bing、Edge 和 Windows 中適用的 Entra ID 使用者聊天 Copilot 。

透過 Microsoft Graph 存取的提示、回應和數據不會用來訓練基礎 LLM,包括 適用於 Microsoft 365 的 Microsoft Copilot 所使用的 LLM。

Rytr

Privacy

就是一般常見的隱私權條款,

沒有特別說明 AI 數據隱私與利用使用者資料的部分,

最後更新日期還是很久以前…Monday, April 4, 2022

看來他們的 A better, 10x faster way to write,並沒有幫助到他們寫那些法律文件或企業揭露資訊的部份。

Jasper.ai

Uncovering the Mystery of Data Privacy in AI With Jasper’s Director of Information Security

點擊查看條文摘要:

Well with Jasper for example, some time ago we entered agreements with all the third-party models we use where they cannot train on the data our customers input. Nothing that goes to the platform will ever be used to train any of those models, whether that be a customer company’s documentation to enhance their brand’s voice or a custom input typed directly into Jasper.And that’s partially to protect the data itself but also to make customers feel comfortable using AI since it’s such a new technology. It’s the biggest concern we hear from customers and a major one for us as we do more research in this area, so we’re addressing it right away.

Jasper與第三方模型的協議禁止使用客戶輸入的數據進行訓練,以保護數據並增加客戶對AI技術的信任。

Canva

點擊查看條文摘要:

Canva uses technology provided by third party service providers to provide some of our AI Products. You acknowledge that any Input you provide, including any personal data you choose to include within that Input, will be shared with third party service providers we engage to enable functionality within the Service. By using the AI Products, you direct and consent to personal data you include in an Input being transferred to third parties, including OpenAI, LLC. in the United States, which depending on where you reside, may not provide the same level of protection for your personal data.Subject to your Privacy Settings, we may also share your data with select third party service providers we engage to enable functionality within the Service and they may also use your data to improve their services. This may include any personal data you choose to include within such Input and you acknowledge that our Privacy Policy applies to the handling of such personal data.

輸入包含的任何個人數據,將與我們合作以實現服務功能的第三方服務提供商共享。(但沒講會如何利用)

另外在這一篇中比較多內容提到關於是否會用拿使用者資料作 AI 訓練,以及資料隱私的部分 Introducing Canva Shield: Safe, fair and secure AI

We’re committed to not training our proprietary AI models on Canva Creator content without their explicit permission. We’re putting proactive consent in place, which means Canva Creators can opt out of having their designs used to train our AI models at any time.

We won’t train on your private content without permission. By default, all Canva users are opted out of private design content, such as the text in your designs, from being used to train our proprietary AI models. You can also opt-out at any time from sharing general information with us, such as your search queries or the fonts you like using. This information helps us to build a better and more personalized product experience, but is entirely optional and up to you.

Copy AI

Trust is at the Heart of Copy.ai

點擊查看條文摘要:

We don't train on your data

Your prompts and ideas fuel your success, not our AI models. We value your trust, ensuring our models are trained without utilizing your individual data.We don’t share your prompts

Your teams creativity is unique. We respect this individuality, and ensure that your prompts, and creative inputs are never shared with other customers.We don’t sell your data

Copy.ai is a subscription-based service; we don’t trade in your data. We do not have, nor will we ever have, a revenue model that exploits user data.

非常直白:不用使用者資料來訓練、不會共享 prompt、不會販賣資料。

OpenAI ChatGPT

點擊查看條文摘要:

Web interface:\ To disable chat history and model training, navigate to ChatGPT > Data Controls. While history is disabled, new conversations won’t be used to train and improve our models, and won’t appear in the history sidebar. To monitor for abuse, we will retain all conversations for 30 days before permanently deleting. \How does OpenAI use my personal data?

Our large language models are trained on a broad corpus of text that includes publicly available content, licensed content, and content generated by human reviewers. We don’t use data for selling our services, advertising, or building profiles of people—we use data to make our models more helpful for people. ChatGPT, for instance, improves by further training on the conversations people have with it, unless you choose to disable training.

聊天紀錄會被拿來訓練,但是網頁版跟 app 都可以設定 opt-out。

Zoom AI

How Zoom AI Companion features handle your data

Zoom 會議軟體多了一些像是產生會議筆記、會議摘要、聊天室摘要之類的,年費美金$159.9以上就能使用。有些人可能只是因為免費版會議只能開40分鐘,太短,為了延長時間而買。 這功能也不是與會者都能用,要先等主持人同意。

點擊查看條文摘要:

Zoom’s unique federated approach to AI is designed to deliver high-quality results by dynamically incorporating Zoom’s own large language model (LLM) in addition to Meta Llama 2, OpenAI, and Anthropic. We evaluate and update our models periodically and models used to support Zoom AI Companion features may change from time to time. Features in AI Companion may use third-party AI-model providers, and we will share relevant data with those third-parties when you use the feature.For example, if you use Chat Compose to help draft responses in Team Chat, the content used to provide the service as described in the section above — the selected chat thread, chat participant names, and your draft response — will be sent to the relevant model to provide the service. Similarly, AI Companion features used in Zoom Meetings that provide summaries or answer questions generate a temporary meeting transcript that will be sent to the relevant model to provide the service.

Even when data is shared, we do not allow third-party AI models to use your data to improve or train their models. Your data may be temporarily retained by those third-parties for Trust and Safety purposes or to comply with legal obligations. Data processed by Zoom AI Companion may be processed within U.S.-based data centers.

Zoom AI Companion 中的功能可能會使用第三方 AI 模型供應商,當您使用該功能時,我們將與這些第三方共用相關資料。

即使共享數據,我們也不允許第三方人工智慧模型使用您的數據來改進或訓練他們的模型。出於信任和安全目的或遵守法律義務,這些第三方可能會暫時保留您的資料。Zoom AI Companion 處理的資料可能會在美國的資料中心內處理。

Simplified

普通制式的隱私權條款,並沒有明確說明是否會拿使用者的資料來訓練 AI。

Adobe

Data and privacy settings

Content analysis FAQ

Adobe 有一個 Creative Cloud 雲端,可以把設計檔案存上去,攝影計畫有 20GB,大全套有 100GB。

應用場景很廣:

- 團隊成員協作,把一些公司 logo 之類的共用素材放上面,從軟體的工具面版可以直接檢視那些檔案,不需要再多開一堆視窗。

- 有時候在電腦作稿,有時候在 iPad 上作業,不用把檔案丟到隨身碟還是怎樣,Adobe 軟體有內建儲存到 Creative Cloud 雲端的功能。

- 還有「共用文件以供審閱」,可以把連結貼給別人,別人可以在上面直接輸入評論,這也會用到雲端。

另外還有一個 Document Cloud,對於共同編輯 PDF、跨裝置編輯、電子簽章等用途提供強大的功能,一樣會儲存大家的各種資料。

點擊查看條文摘要:

How will Adobe protect my privacy?

Adobe takes your privacy seriously. Your privacy is maintained during content analysis for product improvement and development. None of your content is included in our products or services unless you make them public (for example, contributions to Adobe Stock and Behance). The insights obtained through content analysis will not be used to re-create your content or lead to identifying any personal information.You can find an overview of how Adobe may use your information (including content) in the Adobe Privacy Center. For Adobe Firefly, the first model is trained on Adobe Stock images, openly licensed content, and public domain content where the copyright has expired. You can find more information on Adobe Firefly in the Adobe Firefly FAQ.

When does content analysis opt-out not apply?

Turning off content analysis doesn’t affect our ability to analyze your content when you participate in programs where you proactively submit content to develop and improve our products and services. If you don’t want your content to be used for such purposes, you should avoid participating in those programs, including but not limited to:

- Adobe Photoshop Improvement Program: This program allows you to submit the images you edit in Photoshop to help improve machine learning-based features. Learn more, including how to join or leave the program

- Adobe Stock: Content submitted by contributors to Adobe Stock may be used for machine learning.

- Certain features allow you to submit content as feedback

- Certain beta, prerelease, or early access products or features

Additionally, if you use features that rely on content analysis techniques (for example, Content-Aware Fill in Photoshop), your content may still be analyzed when you use those features to help improve that feature.

不會分析電腦本機的檔案,只有傳到線上的才會分析,然後又是嘿保護隱私,資料會處理過…的那套模糊說詞。

在 Adobe 帳號中有一個 “Allow my content to be analyzed by Adobe for product improvement and development purposes.” 的開關,但是關起來之後還是有但書,某些情況還是會把資料拿去訓練,例如:

- 作品是公開的,例如上傳到 Adobe Stock 和 Behance,就會被當做訓練用途,

- 您提交在 Adobe Express 上展示的內容

- 在 Lightroom 中作為教學提交的內容

- 使用某些測試版、預發行版或搶先體驗版產品或功能。

Meta

Meta 主要靠廣告服務維生,那大家投放 Facebook/Instagram 廣告時,上傳的文案、視覺設計、影片、到達網頁內容,會被 Meta 拿來做 AI 訓練嗎? AI 可能不懂詞句或圖案好不好,但是 Meta 有很多數據,知道哪些文案/圖片/影片素材的CTR高、轉換率高、ROAS好…,很難不令人做出聯想。

點擊查看條文摘要:

由於需要如此大量的資料才能訓練出有效模型,因此我們會使用多種來源組合來進行訓練。這些來源包括可在網路公開取得的資訊和已獲授權的資訊,以及 Meta 產品和服務所提供的資訊。若要進一步瞭解我們如何使用 Meta 產品和服務所提供的資訊,請參閱我們的。 當我們從網路收集公開資訊或其他提供者所提供的授權資料來訓練模型時,這些資料中可能含有個人資料。例如,如果我們收集公開的部落格文章,其中可能含有作者的姓名和聯絡資料。當我們用來訓練模型的公開和授權資料中確實含有個人資料時,我們並不會特地將這些資料與任何 Meta 帳號連結。

如果想要將自己的資料退出 AI 訓練,需要另外填寫 生成式 AI 資料主體法定權利表單 裡面有幾個選項,需要填寫國家與個資後送出:

- I want to access, download or correct any personal information from third parties used for training Meta’s generative AI models

- 我要刪除第三方所提供、用於訓練 Meta 生成式 AI 模型的任何個人資料

- 我對第三方所提供、與我從 Meta 生成式 AI 模型獲得的回覆有關的個人資料感到擔心

Box

Security & compliance Box 是一個老牌的雲端硬碟服務,所以也有推出類似 Dropbox 類似的 Box AI,可以用使用者自己的資料做生成式 AI,像是對文件進行問答、整理總結、延伸內容等等。

點擊查看條文摘要:

Enterprise-grade AI that’s safe, secure, and private

Rely on Box’s existing security and privacy for your most sensitive content generated by Box AI. Built-in granular access permissions, wide-ranging industry compliance, and enterprise-grade security will ensure your Box AI data is always protected with secure AI solutions. And AI models are never trained on your data without your written consent, so your proprietary data stays safe and secure.

Box 對於隱私、資安、與合規的相關說明,之前已經有很多說明頁,在這次 AI 產品的服務上也寫了一些直白的文句:

廣泛的行業合規性和企業級安全性將確保您的 Box AI 資料始終受到安全 AI 解決方案的保護。未經您的書面同意,人工智慧模型永遠不會對您的資料進行訓練,因此您的專有資料保持安全可靠。

Leonardo.Ai

Frequently Asked Questions

Private & Public Images

是一個線上版的 AI 圖片生成工具,與 Stable Diffusion 相比,Leonardo.Ai 不需要依賴使用者電腦本機的 GPU 運算資源,而且工具上的設計更加優化,

有著更多專為視覺設計相關的工作流程,或是讓使用者更輕鬆使用 AI 生成圖片,

可以使用平台上的模型,或是訓練自己的模型,

整體過程都還算相當簡單易用,而不需要讓使用者都變成 AI 研究生。

點擊查看條文摘要:

Will my content be kept private or can it be used by Leonardo.Ai or other users?

As per Section 3b of our Terms of Service, images not set to set to public give Leonardo.Ai the right to use, copy, reproduce, adapt, modify, publish, transmit, create derivative works from, display, perform, sublicense, and distribute your text prompts, images, and any generated assets.

This license enables Leonardo.Ai to share these assets publicly and use them for service improvement and promotion.

付費方案可以保有私密性,並避免作品被其他人利用。 免費方案的話,輸入的 prompt 和生成的圖片,平台都擁有使用權。

Dify.AI(LangGenius)

這是可以自己上傳文件、或是使用自己 Notion 上的資料建立知識庫,然後作為上下文建立離天機器人的工具,可以直接產生一個聊天機器人的連結,或是 iframe/js 網頁嵌入碼直接放在網頁上。

中文介面字體是用簡體中文的字體。AI 的回應內容也常常跑出簡體中文字,除了知識庫明明都繁體字,AI 還是會不時變成簡體,如果跟 AI 對談時,問到知識庫資料沒講的東西,AI 還是會自己回覆。

所以對簡體字比較敏感的可能不要用,或是用它的 api 接收回覆,套一層簡中轉繁體的再輸出。

另外還有提供 Dify 社區版,有開放原始碼(後端是Python+Flask),可以部署在自己的伺服器上、用自己的 LLM。

隱私權條款沒有很直白的說明上傳到系統的資料,會不會被平台拿去訓練,日後出現在別人的機器人的回答中。

Cody AI

Security - Your Data is Safe with Us - Cody

這是一個大幅簡化開發內部知識庫聊天機器人的服務:

- 可以上傳自己的文件、簡報、網頁連結然後進行訓練

- 直接產生一個聊天機器人的連結,或是 iframe/js 網頁嵌入碼直接放在網頁上。

- 可以跟 Slack、Discord 串

- 有個 Logs 介面直接看到使用者跟 AI 對談聊了什麼,檢查是否有回答錯誤的地方。

免費版除了能上傳的資料數有限,還只能用 GPT3.5 的 model,聊天機器人還會有 Cody.ai 的 logo。

點擊查看條文摘要:

Documents

Cody utilizes the secure and private Amazon Simple Storage Service (S3) to store your documents in the initial stage before further processing. S3 ensures encryption of all object uploads to all buckets, maintaining compliance with various programs like PCI-DSS, HIPAA/HITECH, FedRAMP, EU Data Protection Directive, and FISMA. This ensures that your data remains protected and compliant with regulatory requirements. Documents uploaded to Cody follow the SSE-S3 (Server-Side Encryption) protocol, allowing exclusive access to you and your team members, ensuring data confidentiality and privacy.Model

Starting on March 1, 2023, we are making two changes to our data usage and retention policies:

- OpenAI will not use data submitted by customers via our API to train or improve our models unless you explicitly decide to share your data with us for this purpose. You can opt-in to share data.

- Any data sent through the API will be retained for abuse and misuse monitoring purposes for a maximum of 30 days, after which it will be deleted (unless otherwise required by law).

上傳的文件主要在在 AWS S3,其他 K8s 之類的也是都在 AWS 上。

LLM 的部份是使用 OpenAI 的 API。

有提到 “You can opt-in to share data.”,但我沒找到那個 opt-in 或 opt-out 的設定。

FacePlay

簡單來說就是 AI 換臉的 APP,不只可以把照片裡的臉換成自己的,裡面還有提供非常多的動態影像(影片)素材,婚紗、cosplay、短影片自拍…各種場景都有。而且可以用中文搜尋模板素材。

至於效果好不好也很難說,因為它是「換臉」,不是換頭,如果換的是不認識的人,效果好像也還過得去。

但如果是認識的人,知道頭型不對、髮型不對、體型不對,一些表情也略顯不自然。而且大家都是同一個素材庫,難免會跟別人”撞影片”。

點擊查看條文摘要:

We analyze your photos to find the feature points of the faces in the photos (eg eyes, nose, mouth points) for face processing. We do not collect facial data. After the analysis process, all data will be deleted and no data will be saved.

We will not share your face data with any third party, nor will we store any face information you submit, and the photos you upload will be deleted after the analysis process is complete.

第一次開啟時,APP 畫面上會寫說「別擔心,我們不會存儲您的任何照片,還有一個說明頁,說分析完臉部特徵就會刪除照片。

JetBrains AI Assistant

JetBrains 公司做了一個知名的開發工具 IntelliJ IDEA,而 JetBrains AI Assistant 則是一個類似 Github Copilot 輔助寫程式碼的 AI 工具。

點擊查看條文摘要:

How we handle your code and data

This data is kept strictly confidential and is used by JetBrains for product improvement purposes only. It is never shared with any external parties, and it will not be used for training any ML models that generate code or text, or revealed in any form to any other users.

說資料只用於改善產品,不會用來訓練任何產生文字或程式碼的機器學習模型,也不會用任何形式洩漏給其他使用者。

Coze AI

Data Processing Addendum - coze Privacy Policy

這服務有兩大特點:

- 可以上傳自己的文件或網頁連結,然後用平台上的各種套件快速生成聊天機器人,跟上面提到的 Cody AI、Dify.AI 有點接近。

- 自己做好的機器人可以”上架”到平台的市集清單內,與 ChatGPT Plus 裡面的 GPTs 類似。

平台上面還可以免費使用 GPT4 8K、GPT4 128K、GPT 3.5 16K 的 API,不用放自己的 API KEY,被中國地區及世界各地的”白嫖黨”視為 AI 大福利。

這個佛心的公司是哪來的? Coze 是由字節跳動(抖音/Tiktok的公司)在海外推出的一個 AI 平台,而字節跳動在 2023/12 才傳出被 OpenAI 封帳號的新聞字節跳動帳戶被暫停 因違規使用OpenAI技術。另外用一間子公司,繼續申請使用 OpenAI 的服務,難免引發爭議。

隱私政策與相關附錄比較像是一般制式條款,將會員註冊資料、使用者與機器人的聊天對話紀錄、上傳到系統上的檔案都混為一談。沒有特別直白的說明會不會被拿去做 AI 訓練,資料是否可能出現在別人的對話中。